考研数学:概率论与数理统计核心公式与概念辨析

本文档根据考研数学大纲,旨在系统梳理概率论与数理统计的核心知识点,便于快速复习。

第一部分:概率论基础

一、基本概率模型与计数原理

1. 古典概型

- 定义:试验的样本空间 Ω 只包含有限个基本事件,且每个基本事件发生的可能性相同。

- 公式:若事件A包含 k 个基本事件,样本空间共有 n 个基本事件,则 P(A)=nk。

- 核心:将概率问题转化为排列组合的计数问题。

2. 几何概型

- 定义:试验的样本空间 Ω 是一个可度量的几何区域(如线段、平面、体),每个样本点出现的可能性相同。

- 公式:若事件A对应的子区域为 AΩ,则 P(A)=μ(Ω)μ(AΩ),其中 μ 是度量(长度、面积、体积)。

- 核心:将概率问题转化为几何图形的度量计算问题。

3. 计数原理与组合公式

- 加法原理:完成一件事有 n 类方法,各类方法相互独立,第 i 类方法有 mi 种,则共有 ∑mi 种方法。

- 乘法原理:完成一件事需要 n 个步骤,各步骤相互独立,第 i 个步骤有 mi 种方法,则共有 ∏mi 种方法。

- 排列 (Permutation):从 n 个不同元素中取出 m 个,按一定顺序排列。Pnm=(n−m)!n!。

- 组合 (Combination):从 n 个不同元素中取出 m 个,不考虑顺序。Cnm=(mn)=m!(n−m)!n!。

4. 常见计数问题 (抽样与分配)

| 问题类型 |

模型 |

总样本数 |

通俗说明 |

| 简单随机抽样 |

有放回 (With Replacement):从n个球中抽r个 |

nr |

每次抽样都有n种选择,共抽r次,且每次选择独立。

例句:“从 n 个球中有放回地抽取 r 次,记录结果。” |

|

无放回,计顺序 (Permutation):从n个球中抽r个 |

Pnr=Cnr⋅r! |

抽出的球不放回,第一次有n种选择,第二次n-1种,以此类推。抽出的顺序不同算作不同结果。

例句:“从 n 个人中选出 r 个人排列成一队。” |

|

无放回,不计顺序 / 任取 (Combination):从n个球中取r个 |

Cnr |

抽出的球不放回,且最终只关心抽到了哪些球,不关心它们的先后顺序。

例句:“从 n 个人中任取 r 个人组成一个委员会。” |

随机分配问题

(r个球, n个盒子) |

球可辨,盒可辨,无容量限制 |

nr |

每个不同的球都有n个不同的盒子可选,共r个球。

例句:“将 r 封不同的信,投入 n 个不同的邮筒。” |

|

球不可辨,盒可辨,无容量限制

(隔板法) |

Cr+(n−1)r |

想象r个球排成一排,需要n-1个“隔板”将它们分成n份。问题转化为在总共 r+n-1 个位置中,选择r个位置放球。

例句:“将 r 个相同的苹果,分给 n 个不同的小朋友,允许有人分不到。” |

|

球可辨,盒可辨,每盒至多一球 (r≤n) |

Pnr=Cnr⋅r! |

第一个球有n个盒子可选,第二个有n-1个,以此类推。相当于从n个盒子中选r个进行排列。

例句:“将 r 个不同的球,放入 n 个不同的盒子,每盒最多放一个。” |

|

球不可辨,盒可辨,每盒至多一球 (r≤n) |

Cnr |

因为球无差别,所以只需从n个盒子中选出r个来放球即可,无需考虑顺序。

例句:“将 r 个相同的球,放入 n 个不同的盒子,每盒最多放一个。” |

二、概率论基本概念与公式

1. 核心概念辨析:独立 vs. 互不相容 vs. 不相关

这三个概念描述了事件或随机变量之间不同层面的关系,极易混淆。

| 概念 |

定义 |

研究对象 |

关系与辨析 |

| 互不相容 (互斥) |

AB=∅

P(AB)=0 |

事件 |

描述事件能否同时发生。若A、B为对立事件,则它们必互不相容,反之不然。若P(A)>0,P(B)>0,则A, B不可能既独立又互不相容。 |

| 相互独立 |

事件: P(AB)=P(A)P(B)

变量: F(x,y)=FX(x)FY(y) |

事件、随机变量 |

描述事件发生概率是否相互影响。独立是概率层面的关系,比不相关更强。 |

| 不相关 |

E(XY)=E(X)E(Y)

Cov(X,Y)=0 |

随机变量 |

描述随机变量之间是否存在线性关系。独立一定不相关,但不相关不一定独立(除非X, Y服从二维正态分布)。 |

2. 重要概率基本公式

设 A, B 为任意两个事件。

| 公式名称 |

公式内容 |

备注 |

| 加法公式 |

P(A∪B)=P(A)+P(B)−P(AB) |

若A, B互不相容,则 P(A∪B)=P(A)+P(B) |

| 减法公式 |

P(A−B)=P(A)−P(AB) |

A−B 指事件A发生而B不发生。仅当 B⊂A 时,才有 P(A−B)=P(A)−P(B) |

| 条件概率 |

P(A∣B)=P(B)P(AB) |

P(B)>0 |

| 乘法公式 |

P(AB)=P(A)P(B∣A)=P(B)P(A∣B) |

若A, B独立,则 P(AB)=P(A)P(B) |

| 全概率公式 |

P(A)=∑i=1nP(Bi)P(A∣Bi) |

B1,…,Bn 是一个完备事件组 |

| 贝叶斯公式 |

P(Bi∣A)=j=1∑nP(Bj)P(A∣Bj)P(Bi)P(A∣Bi) |

用于"执果索因",在已知A发生的情况下,计算来自Bi的概率 |

3. 全概率公式与贝叶斯公式的理解 (全集分解)

一件事(事件A)的发生,其原因往往是复杂的,可能是由多种互斥的原因(B1,B2,…,Bn)之一所引起的。在这种情况下,我们就需要考虑对样本空间进行 全集分解。

-

什么是全集分解:

设 B1,B2,…,Bn 是一组事件,如果它们满足:

- 两两互斥:BiBj=∅ (对于任意 i=j)

- 并集为全集:i=1⋃nBi=Ω (完备事件组)

那么,这组事件就构成了样本空间 Ω 的一个分解。你可以把它们想象成将一整块蛋糕切成了n块,互不重叠,且刚好拼成完整的蛋糕。每一块 Bi 就代表了一种可能的原因或场景。

-

公式的应用:

- 全概率公式:计算的是“结果”A的总概率。它通过“把所有原因都考虑进去”的方式,将A在各种原因Bi下发生的概率 P(A∣Bi),用原因Bi自身的概率 P(Bi) 作为权重进行加权求和,最终得到 P(A)。

- 贝叶斯公式:是全概率公式的“逆过程”。当我们已经观测到“结果”A发生了,回过头去推断它是由某一个特定“原因”Bi所导致的概率有多大,即求 P(Bi∣A)。这正是“执果索因”的数学体现。

三、一维随机变量及其常见分布

1. 分布函数、概率质量/密度函数

-

分布函数 (CDF - Cumulative Distribution Function):

对于任意随机变量X,其分布函数定义为 F(x)=P{X≤x}。

核心性质:

- 0≤F(x)≤1

- F(x) 是单调不减函数,且右连续。

- F(−∞)=0,F(+∞)=1

- P{a<X≤b}=F(b)−F(a)

常见构造分布函数的形式:

- 线性组合:若 Fi(x) 为分布函数,λi≥0,∑λi=1,则 ∑λiFi(x) 也是分布函数。

- 均值形式:

- 算术均值 2F1(x)+F2(x) 是分布函数。

- 几何均值 F1(x)F2(x) 也是分布函数。

- 积分均值:若 F(x) 是分布函数,则其在 [x,x+T] 上的均值 T1∫xx+TF(t)dt 也是分布函数。

- 最值分布:

- 最大值分布:[F(x)]n 是分布函数。

- 最小值分布:1−[1−F(x)]n 是分布函数。

- 经验分布函数 Fn(x) 是分布函数。

-

离散型 - 概率质量函数 (PMF - Probability Mass Function):

P{X=xk}=pk,其中 pk≥0,k∑pk=1。分布函数 F(x) 是阶梯状的跳跃函数。

-

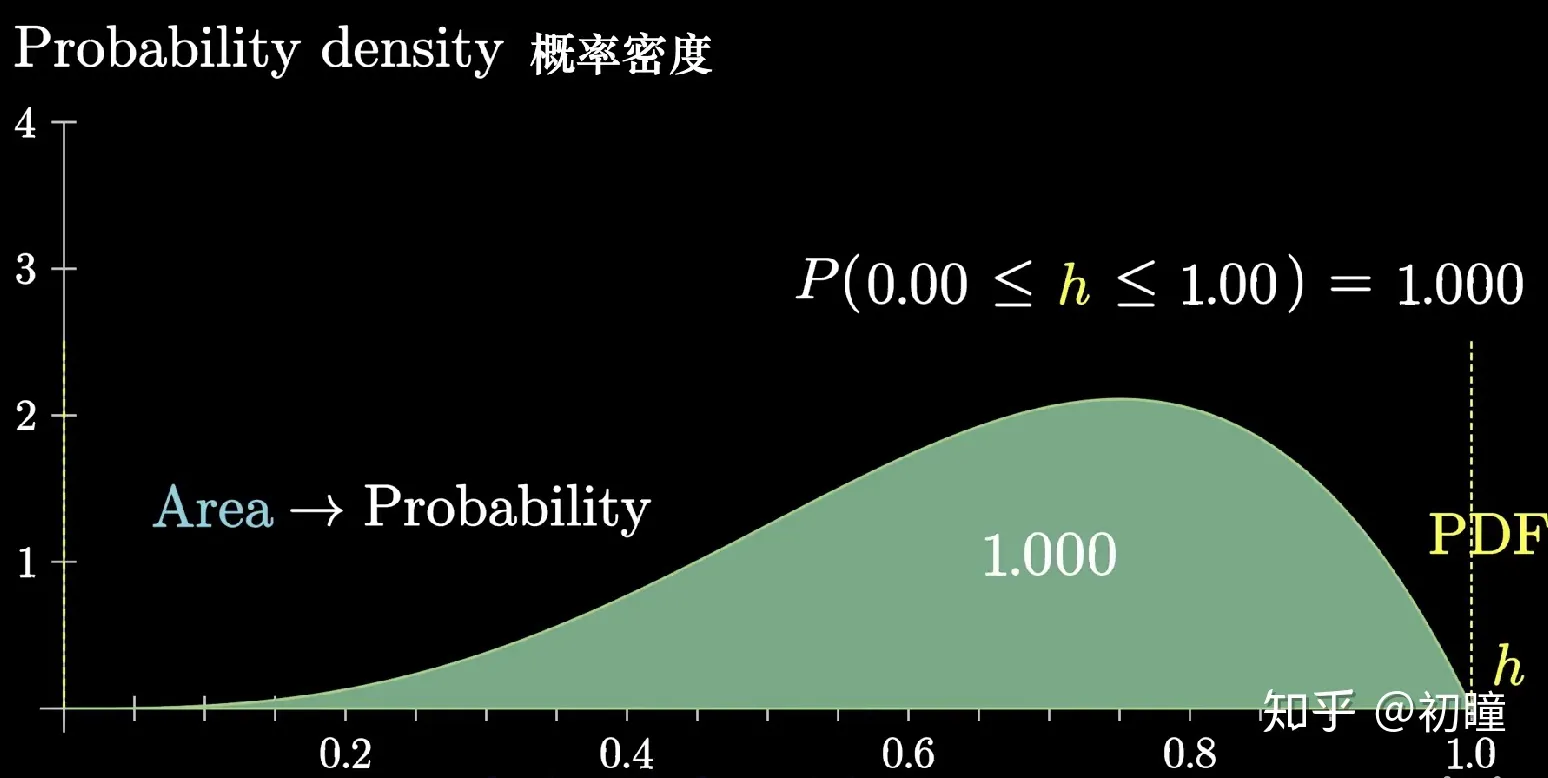

连续型 - 概率密度函数 (PDF - Probability Density Function):

如果存在非负函数 f(x) 使得 F(x)=∫−∞xf(t)dt,则称 X 为连续型随机变量,f(x) 为其概率密度函数。

核心性质:

- f(x)≥0

- ∫−∞∞f(x)dx=1

- 在 f(x) 的连续点上,F′(x)=f(x)

- P{a<X≤b}=∫abf(x)dx

常见构造概率密度函数的形式:

- 线性组合:若 fi(x) 为概率密度,λi≥0,∑λi=1,则 ∑λifi(x) 也是概率密度 (如算术均值)。

- 积分变换:若 f(x) 是概率密度,则其在 [x,x+T] 上的均值 T1∫xx+Tf(t)dt 也是概率密度。

- 导数关系:

- (n1∑Fi(x))′=n1∑fi(x) 是概率密度。

- (F1(x)…Fn(x))′=∑[F1(x)…fk(x)…Fn(x)] 是概率密度。

- 最值密度:

- 最大值密度:n[F(x)]n−1f(x)。

- 最小值密度:n[1−F(x)]n−1f(x)。

-

经验分布函数(也是一种分布函数)

定义:

Fn(x)=nx1,x2,⋅⋅⋅,xn中小于x的样本个数

性质:

- 是统计量(是不含未知参数的函数)

- 是X≤x发生的概率

- 是分布函数(①F(+∞)=1、②F(−∞)=0、③单调不减且右连续)

- Fn(x)pF(x) (近似)

- E[Fn(x)=F(x)]

-

补充:两种重要的变换(变为 U(0,1) 或 E(1))

- 变换:Y=FX(X)∼U(0,1)。

P{Y≤y}=P{FX(X)≤y}=P{X≤FX−1(y)}=P{FX[FX−1(y)]}=y

- 变换:Y=−ln(1−FX(X))∼E(1)

P{Y≤y}=P{−ln(1−FX(X))≤y}=P{1−FX(X)≥e−y}=P{FX(X)≤1−e−y}=1−e−y

2. 常见分布的性质汇总表

| 分布 |

概率函数 (PMF/PDF) |

分布函数 (CDF) |

E(X) 与 D(X) |

0-1分布 (离散)

B(1,p) 有可加性

抛一次硬币的结果 |

P{X=k}=pk(1−p)1−k

for k=0,1 |

F(x)=⎩⎨⎧0,1−p,1,x<00≤x<1x≥1 |

E(X)=p

D(X)=p(1−p) |

二项分布 (离散)

B(n,p) 有可加性

抛n次硬币,正面朝上的次数 |

P{X=k}=Cnkpk(1−p)n−k |

F(x)=k=0∑⌊x⌋Cnkpk(1−p)n−k |

E(X)=np

D(X)=np(1−p) |

泊松分布 (离散)

P(λ) 有可加性

一小时内某路口的车辆数 |

P{X=k}=k!λke−λ |

F(x)=k=0∑⌊x⌋k!λke−λ |

E(X)=λ

D(X)=λ |

几何分布 (离散)

G(p)

连续射击,首次命中时的次数 |

P{X=k}=(1−p)k−1p

for k=1,2,… |

F(x)=1−(1−p)⌊x⌋

for x≥1 |

E(X)=p1

D(X)=p21−p |

超几何分布 (离散)

H(N,M,n)

(N总, M成功, n抽)

产品抽检(不放回)次品数 |

P{X=k}=CNnCMkCN−Mn−k

max(0,n+M−N)≤k≤min(n,M) |

F(x)=i=0∑⌊x⌋CNnCMiCN−Mn−i |

E(X)=nNM

D(X)=nNM(1−NM)N−1N−n |

均匀分布 (连续)

U(a,b)

随机数生成 |

f(x)={b−a1,0,a<x<b其他 |

F(x)=⎩⎨⎧0,b−ax−a,1,x<aa≤x<bx≥b |

E(X)=2a+b

D(X)=12(b−a)2 |

指数分布 (连续)

E(λ)(=Γ(1,λ))

可视为有可加性 ∑i=1nE(λ)∼Γ(n,λ)

电子元件寿命、服务等待时间 |

f(x)={λe−λx,0,x>0x≤0 |

F(x)={1−e−λx,0,x>0x≤0

无记忆性:

P{X≥t+s∣X≥t}=P{X≥s} |

E(X)=λ1

D(X)=λ21 |

正态分布 (连续)

N(μ,σ2) 有可加性

大量人群的身高、体重分布 |

f(x)=σ2π1e−21(σx−μ)2 |

F(x)=Φ(σx−μ) |

E(X)=μ

D(X)=σ2 |

卡方分布 (连续)

χ2(n) 有可加性

用于方差检验的统计量 |

(统计量构造方法)设 Xi∼N(0,1) 相互独立,

则 i=1∑nXi2∼χ2(n) |

- |

E(X)=n

D(X)=2n |

t分布 (连续)

t(n)

用于均值检验的统计量 |

(统计量构造方法)设 X∼N(0,1),Y∼χ2(n) 相互独立,

则 t=Y/nX∼t(n) |

特殊:t(1)称标准柯西分布

X∼f(x)=π(1+x2)1

均值、方差都不收敛,所以没有均值、方差 |

E(X)=0 (当 n>1)

D(X)=n−2n (当 n>2) |

F分布 (连续)

F(n1,n2)

用于方差比较的统计量 |

(统计量构造方法)设 X∼χ2(n1),Y∼χ2(n2) 相互独立,

则 F=Y/n2X/n1∼F(n1,n2) |

- |

E(X)=n2−2n2 (当 n2>2)

D(X)=n1(n2−2)2(n2−4)2n22(n1+n2−2) (当 n2>4) |

伽马分布 (连续)

Γ(α,λ) 有可加性

广义的指数分布 |

f(x)=Γ(α)λαxα−1e−λx

x>0 |

F(x)=∫0xf(t)dt |

E(X)=λα

D(X)=λ2α |

拉普拉斯分布 (连续)

L(μ,b)

双指数分布 |

f(x)=2b1e−b∣x−μ∣ |

F(x)={21ebx−μ,1−21e−bx−μ,x<μx≥μ |

E(X)=μ

D(X)=2b2 |

补充:指数分布与卡方分布的特殊关系

-

无记忆性:

若 X∼E(λ),则 P{X≥t+s∣X≥t}=P{X≥s}。λ 称为失效率,只有失效率不变、元件无损耗时,才有无记忆性。

-

与 χ2 分布的联系:

- 特别地,当 λ=21 时,X∼E(21) 的概率密度为 f(x)={21e−2x,0,x≥0x<0。

- 此时称 X 服从自由度为 2 的卡方分布,即 E(21) 与 χ2(2) 是同一分布。

-

重要推论 (线性变换):

- 若 X∼E(21),则 2X∼E(21),即 2X∼χ2(2)。

- 若 X∼E(λ),则 2λX∼E(21),即 2λX∼χ2(2)。

- 应用:利用此性质可将一般的指数分布问题转化为卡方分布问题。

推导证明:

-

证明 E(21) 与 χ2(2) 同分布

- E(21) 的 PDF:fX(x)=21e−2x(x>0)

- χ2(2) 的 PDF:代入卡方分布通项公式 f(y)=22nΓ(2n)1y2n−1e−2y。

当 n=2 时,Γ(1)=1,得 fY(y)=21e−2y(y>0)

- 结论:两者 PDF 一致,故分布相同。

-

证明 X∼E(λ)⟹2λX∼χ2(2)

- 令 Y=2λX,则 X=2λY,变换导数 dydx=2λ1。

- 根据变量变换公式:fY(y)=fX(2λy)⋅2λ1=λe−λ2λy⋅2λ1=21e−2y

- 结论:结果正是 χ2(2) 的密度函数。

补充:伽马分布 Γ(α,λ) 是指数分布和卡方分布的推广

- 当 α=1 时,Γ(1,λ)=E(λ) (指数分布)。

- 当 α=2n,λ=21 时,Γ(2n,21)=χ2(n) (卡方分布)。

- 可加性:若 X1∼Γ(α1,λ),X2∼Γ(α2,λ) 且相互独立,则 X1+X2∼Γ(α1+α2,λ)。

这解释了为什么 n 个独立同分布的指数分布 E(λ) 之和服从 Γ(n,λ)。

补充:拉普拉斯分布与正态分布的对比:

- 拉普拉斯分布又称双指数分布,由两个指数分布背靠背拼接而成。

- 尖峰厚尾:与正态分布相比,拉普拉斯分布在均值处更尖(概率密度更高),在尾部也更厚(极端值出现的概率比正态分布大)。

- 在机器学习中,L1正则化(Lasso)对应于参数服从拉普拉斯先验分布,倾向于产生稀疏解(即许多参数为0);而L2正则化(Ridge)对应于参数服从正态先验分布。

四、二维随机变量及其分布

1. 联合分布

- 联合分布函数:F(x,y)=P{X≤x,Y≤y}

- 离散型 - 联合概率分布律:P{X=xi,Y=yj}=pij

- 连续型 - 联合概率密度:f(x,y),具有性质:

- f(x,y)≥0

- ∫−∞∞∫−∞∞f(x,y)dxdy=1

- F(x,y)=∫−∞x∫−∞yf(u,v)dudv

- ∂x∂y∂2F(x,y)=f(x,y)

2. 边缘分布

边缘分布是二维随机变量中单个变量的分布。

-

边缘分布函数:

- FX(x)=P{X≤x}=F(x,+∞)

- FY(y)=P{Y≤y}=F(+∞,y)

-

离散型 - 边缘分布律:

- pi⋅=P{X=xi}=j=1∑∞pij (对 j 求和)

- p⋅j=P{Y=yj}=i=1∑∞pij (对 i 求和)

-

连续型 - 边缘密度函数:

- fX(x)=∫−∞∞f(x,y)dy (对 y 积分)

- fY(y)=∫−∞∞f(x,y)dx (对 x 积分)

3. 条件分布

条件分布是在一个变量取给定值的条件下,另一个变量的分布。

-

离散型 - 条件分布律:

- P{X=xi∣Y=yj}=P{Y=yj}P{X=xi,Y=yj}=p⋅jpij

- P{Y=yj∣X=xi}=P{X=xi}P{X=xi,Y=yj}=pi⋅pij

-

连续型 - 条件密度函数:

- fX∣Y(x∣y)=fY(y)f(x,y) (要求 fY(y)>0)

- fY∣X(y∣x)=fX(x)f(x,y) (要求 fX(x)>0)

4. 随机变量的独立性

X,Y 相互独立的充要条件是它们的联合分布等于边缘分布的乘积。

- F(x,y)=FX(x)FY(y)

- 离散型:pij=pi⋅⋅p⋅j

- 连续型:f(x,y)=fX(x)fY(y)

5. 二维正态分布

二维正态分布是多元正态分布中最简单的情形,也是应用最广泛的多元连续分布。它由五个参数描述:两个期望 μ1,μ2,两个方差 σ12,σ22,以及一个相关系数 ρ。记作 (X,Y)∼N(μ1,μ2,σ12,σ22,ρ)。

-

概率密度函数:

f(x,y)=2πσXσY1−ρ21exp(−2(1−ρ2)1[(σXx−μX)2−2ρ(σXx−μX)(σYy−μY)+(σYy−μY)2])

-

重要性质:

- 边缘分布:二维正态分布的两个边缘分布仍然是正态分布:

- X∼N(μ1,σ12)

- Y∼N(μ2,σ22)

- 条件分布:在给定一个变量的条件下,另一个变量的条件分布也是正态分布。

- 给定 X=x,Y 的条件分布为:

Y∣X=x∼N(μY+ρσXσY(x−μX),σY2(1−ρ2))

- 给定 Y=y,X 的条件分布为:

X∣Y=y∼N(μX+ρσYσX(y−μY),σX2(1−ρ2))

- 正态分布的线性组合(可加性) 也符合正态分布:

i=1∑naiXi∼N(i=1∑naiμi,i=1∑nai2σi2)

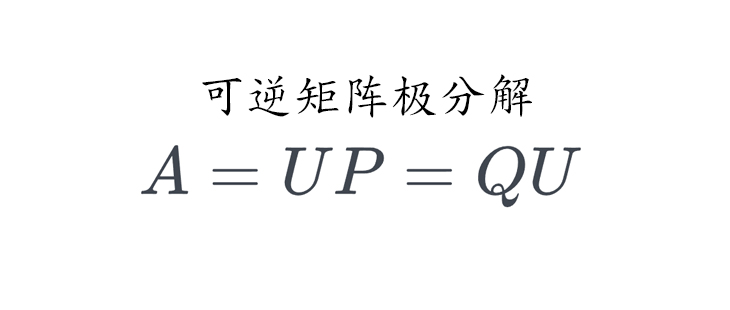

- 对正态分布进行 可逆线性变换得到的新二维分布 仍然是正态分布:

(X1,X2)∼N,做如下可逆线性变换,即:

{Y1=a1X1+b1X2Y2=a2X1+b2X2,a1a2b1b2=0⟹(Y1,Y2)∼N

-

不相关与独立的等价性:对于二维正态分布,“不相关”与“相互独立”是等价的。即 ρ=0⟺Cov(X,Y)=0⟺X,Y 相互独立。这是二维正态分布最重要的性质。

-

样本均值 Xˉ,Yˉ 的协方差 Cov(Xˉ,Yˉ) 与相关系数 ρXˉYˉ:

设 (X1,Y1),…,(Xn,Yn) 是来自二维正态总体 (X,Y) 的简单随机样本,Xˉ,Yˉ 为样本均值。

- 协方差:Cov(Xˉ,Yˉ)=nρσ1σ2

- 相关系数:ρXˉYˉ=ρ (样本均值的相关系数等于总体相关系数)

推导:

Cov(Xˉ,Yˉ)=n21i∑j∑Cov(Xi,Yj)=n21i∑Cov(Xi,Yi)=n2nρσ1σ2=nρσ1σ2ρXˉYˉ=D(Xˉ)D(Yˉ)Cov(Xˉ,Yˉ)=nσ12⋅nσ22nρσ1σ2=ρ

补充:二维正态分布中"不相关"与"相互独立"等价的证明

通常情况下,两个随机变量相互独立,那么它们一定不相关。但反过来,不相关并不一定能推出相互独立。然而,对于二维正态分布来说,这是一个特例,“不相关”与“相互独立”是等价的。

简要总结:对于二维正态分布,X和Y不相关时,其f(x,y)=fX(x)fY(y),因此此时X和Y相互独立。又由于“独立”总是能推出“不相关”,因此两者是等价的。

假设随机变量 (X,Y) 服从二维正态分布,其参数为 (μX,μY,σX2,σY2,ρ)。其联合概率密度函数为:

f(x,y)=2πσXσY1−ρ21exp(−2(1−ρ2)1[(σXx−μX)2−2ρ(σXx−μX)(σYy−μY)+(σYy−μY)2])

其中 ρ 是 X 和 Y 的相关系数。

如果 X 和 Y 不相关,根据定义,它们的相关系数 ρ=0。我们将 ρ=0 代入上面的联合概率密度函数公式:

f(x,y)=2πσXσY1exp(−21[(σXx−μX)2+(σYy−μY)2])=[σX2π1exp(−2σX2(x−μX)2)]⋅[σY2π1exp(−2σY2(y−μY)2)]

我们知道,服从正态分布 N(μX,σX2) 的随机变量 X与服从正态分布 N(μY,σY2) 的随机变量 Y 的边际概率密度函数分别为

fX(x)fY(y)=σX2π1exp(−2σX2(x−μX)2)=σY2π1exp(−2σY2(y−μY)2)

因此,当 ρ=0 时,我们有 f(x,y)=fX(x)⋅fY(y)。根据随机变量相互独立的定义,如果其联合概率密度函数等于其边际概率密度函数的乘积,则这两个随机变量相互独立。

综上所述,对于二维正态分布,若 X 和 Y 不相关,则它们必定相互独立。由于“独立”总是能推出“不相关”,因此两者是等价的。

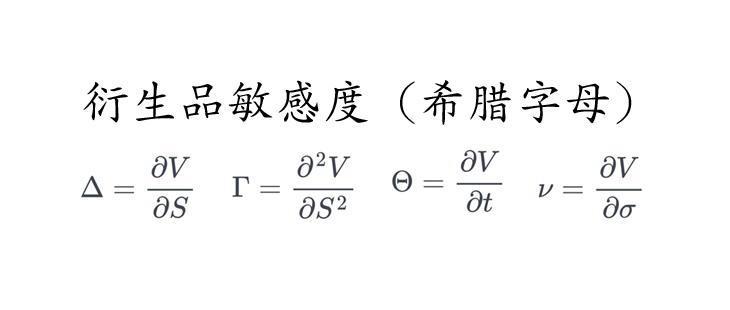

6. 二维随机变量函数的分布 (变量变换法)

对于二维连续型随机变量 (X,Y),求其函数 Z=g(X,Y) 的分布,通常有两种方法。

方法一:分布函数法 (通用)

通过定义求 Z 的分布函数 FZ(z)=P{Z≤z}=P{g(X,Y)≤z},即在 xy 平面上对满足 g(x,y)≤z 的区域进行二重积分,然后求导得到密度函数 fZ(z)。

方法二:公式法 (常用变换)

对于 U=U(X,Y),V=V(X,Y) 这样的变量变换,若变换可逆且存在连续偏导数,可以使用雅可比行列式 (Jacobian) 求解。

- 反解:从 u=u(x,y),v=v(x,y) 中解出 x=x(u,v),y=y(u,v)。

- 计算雅可比行列式:

J=∂(u,v)∂(x,y)=∂u∂x∂u∂y∂v∂x∂v∂y

- 求联合密度:(U,V) 的联合密度函数为 fU,V(u,v)=fX,Y[x(u,v),y(u,v)]⋅∣J∣。注意此处是乘以雅各比行列式的绝对值

- 求边缘密度:对不需要的变量积分,即可得到目标变量的密度函数。

应用:推导 Z = X + Y 的卷积公式

-

构造变换:

我们要求 Z=X+Y 的分布。为了使用雅可比法,需要引入一个辅助变量,最简单的就是令 V=Y。

于是有变换:Z=X+Y, V=Y。

-

反解:

X=Z−V, Y=V。

-

计算雅可比行列式:

J=∂(z,v)∂(x,y)=∂z∂x∂z∂y∂v∂x∂v∂y=10−11=1⋅1−(−1)⋅0=1

∣J∣=1。

-

求联合密度:

fZ,V(z,v)=fX,Y(z−v,v)⋅∣J∣=fX,Y(z−v,v)。

-

求边缘密度 (积分):

为了得到 Z 的密度函数 fZ(z),我们需要对辅助变量 v 进行积分:

fZ(z)=∫−∞∞fZ,V(z,v)dv=∫−∞∞fX,Y(z−v,v)dv

如果我们当初选择 V=X 作为辅助变量,会得到另一个等价的形式:

fZ(z)=∫−∞∞fX,Y(z−x,x)dx

这两个积分形式,正是卷积公式。

重要结论 (常用分布的可加性)

-

正态分布:若 X∼N(μ1,σ12),Y∼N(μ2,σ22),且 X,Y 相互独立,则

aX±bY∼N(aμ1±bμ2,a2σ12+b2σ22)

特别地,

X±Y∼N(μ1±μ2,σ12+σ22)

-

泊松分布:若 X∼P(λ1),Y∼P(λ2),且 X,Y 相互独立,则

X+Y∼P(λ1+λ2)

-

二项分布:若 X∼B(n1,p),Y∼B(n2,p),且 X,Y 相互独立,则

X+Y∼B(n1+n2,p)

(注意:p 必须相同)

若X∼B(n,p),那么

n−X∼B(n,1−p)

例如以下例题:

题目:已知随机变量 X 服从如下分布:

X∼(−141021141)

N1,N2,N3 是 n 次独立重复实验中 X 取 −1,0,1 的次数(满足 N1+N2+N3=n)。

求 N1,N2 的边缘分布、期望、方差,以及相关系数 ρN1,N2。

解:

-

确定边缘分布与数字特征

对于单次试验,N1 对应事件 {X=−1}(概率 p1=1/4),N2 对应事件 {X=0}(概率 p2=1/2)。故它们分别服从二项分布:

N1∼B(n,1/4),N2∼B(n,1/2)

于是有:

E(N1)E(N2)=4n,=2n,D(N1)D(N2)=n⋅41⋅43=163n=n⋅21⋅21=4n

-

求解协方差 Cov(N1,N2)

考虑随机变量 N1+N2,它代表 X 取 −1 或 0 的总次数。

由于事件 {−1} 与 {0} 互斥,其发生概率为 p1+p2=3/4。

∴N1+N2∼B(n,3/4)

利用方差公式:

D(N1+N2)=n⋅43⋅41=163n

又由方差性质 D(N1+N2)=D(N1)+D(N2)+2Cov(N1,N2),代入得:

163n2Cov(N1,N2)Cov(N1,N2)=163n+4n+2Cov(N1,N2)=−4n=−8n

-

求解相关系数 ρN1,N2

ρN1,N2=D(N1)D(N2)Cov(N1,N2)=163n⋅4n−n/8=8n3−n/8=−31=−33

-

χ2 分布 (卡方分布):若 X∼χ2(n1),Y∼χ2(n2),且 X,Y 相互独立,则

X+Y∼χ2(n1+n2)

-

Γ 分布(伽马分布): 若 X1∼Γ(α1,λ),X2∼Γ(α2,λ) 且相互独立,则

X1+X2∼Γ(α1+α2,λ)

又因为当 α=1 时,Γ(1,λ)=E(λ) (指数分布,P{X≤x}=1−e−λx),因此, n 个独立同分布的指数分布 E(λ) 之和服从 Γ(n,λ)。

i=1∑nE(λ)∼Γ(n,λ)

应用:求 Z = max/min 函数的分布

设 X1,X2,…,Xn 为 n 个相互独立的随机变量,其分布函数分别为 FXi(x),密度函数为 fXi(x)。求解这类问题的核心是分布函数法。

-

最大值 Y=max(X1,…,Xn) 的分布:

- 分布函数 (CDF):

事件 {max(Xi)≤y} 等价于事件 {X1≤y,…,Xn≤y}。FY(y)=P{Y≤y}=P{X1≤y,…,Xn≤y}

因为各变量独立,所以:FY(y)=i=1∏nP{Xi≤y}=i=1∏nFXi(y)

- i.i.d. 情况:若 Xi 独立同分布 (CDF为FX(x)),则 FY(y)=[FX(y)]n。

- 概率密度 (PDF) (i.i.d.情况):fY(y)=FY′(y)=n[FX(y)]n−1fX(y)。

-

最小值 Z=min(X1,…,Xn) 的分布:

- 分布函数 (CDF) (使用对立事件):

事件 {min(Xi)>z} 等价于事件 {X1>z,…,Xn>z}。FZ(z)=P{Z≤z}=1−P{Z>z}=1−P{X1>z,…,Xn>z}

因为各变量独立,所以:FZ(z)=1−i=1∏nP{Xi>z}=1−i=1∏n[1−FXi(z)]

- i.i.d. 情况:若 Xi 独立同分布,则 FZ(z)=1−[1−FX(z)]n。

- 概率密度 (PDF) (i.i.d.情况):fZ(z)=FZ′(z)=n[1−FX(z)]n−1fX(z)。

第二部分:随机变量的数字特征

一、数学期望 (E(X))

数学期望是随机变量取值的加权平均值,反映了随机变量取值的平均水平。

1. 定义

-

离散型随机变量:X 的概率分布为 P{X=xk}=pk, k=1,2,…

E(X)=k=1∑∞xkpk

-

连续型随机变量:X 的概率密度函数为 $ f(x)$

E(X)=∫−∞∞xf(x)dx

补充公式 (非负随机变量期望的尾概率公式):

设连续型随机变量 X≥0 的分布函数为 F(x),且 EX 存在,则:

E(X)=∫0+∞[1−F(x)]dx

证明思路:利用交换积分次序 (化归经典形式)

E(X)=∫0+∞xf(x)dx=∫0+∞(∫0xdy)f(x)dx=∫0+∞dy∫y+∞f(x)dx=∫0+∞[1−F(y)]dy

2. 随机变量函数的期望

设 Y=g(X),则 E(Y)=E[g(X)]

- 离散型:k=1∑∞g(xk)pk

- 连续型:∫−∞∞g(x)f(x)dx

3. 数学期望的性质

| 性质 |

期望公式 E(·) |

方差公式 D(·) |

条件与说明 |

| 常数 c |

E(c)=c |

D(c)=0 |

|

| 期望的期望 |

E[E(X)]=E(X) |

- |

因为 E(X) 本身是一个常数。 |

| 线性运算 |

E(aX+b)=aE(X)+b |

D(aX+b)=a2D(X) |

方差的性质 D(X+c)=D(X) 和 D(aX)=a2D(X) 可由此推出。 |

| 线性组合 (通用) |

E(aX±bY)=aE(X)±bE(Y) |

D(aX±bY)=a2D(X)+b2D(Y)±2abCov(X,Y) |

期望的线性性质无条件成立。 |

| 线性组合 (独立) |

E(aX±bY)=aE(X)±bE(Y) |

D(aX±bY)=a2D(X)+b2D(Y) |

X,Y 相互独立 |

| n个变量的和 |

E[i=1∑nXi]=i=1∑nE(Xi) |

D(i=1∑nXi)=i=1∑nD(Xi) |

期望公式无条件成立。方差公式要求 Xi 相互独立。若 Xi 同分布 (E(Xi)=μ), 则期望为 nμ。 |

| 函数和 |

E[i=1∑ngi(Xi)]=i=1∑nE[gi(Xi)] |

D[i=1∑ngi(Xi)]=i=1∑nD[gi(Xi)] |

期望公式无条件成立。方差公式要求 Xi 相互独立。 |

| 乘积 (独立) |

E(XY)=E(X)E(Y) |

D(XY)=D(X)D(Y)+D(X)[E(Y)]2+D(Y)[E(X)]2 |

X,Y 相互独立。由此可得 D(XY)≥D(X)D(Y) |

| 样本均值 X |

E(X)=μ |

D(X)=nσ2 |

样本 Xi 来自正态总体 N(μ,σ2),相互独立 |

| 样本方差S2 |

E(S2)=σ2 |

D(S2)=n−12σ4 |

样本 Xi 来自正态总体 N(μ,σ2),相互独立,且此时 S2 和 X 必定相互独立 |

| 正态样本的绝对值∣X∣的期望 |

E(∣X∣)=π2σ |

D(∣X∣)=(1−π2)σ2 |

Xi∼N(0,σ2) |

二、方差 (D(X))

方差衡量了随机变量与其期望值的偏离程度,反映了随机变量取值的稳定性。

1. 定义与计算公式

- 定义:D(X)=E[(X−E(X))2]

- 计算公式:D(X)=E(X2)−[E(X)]2

2. 方差的性质

| 性质 |

公式 |

条件 |

易错点说明 |

| 常数的方差 |

D(c)=0 |

无 |

|

| 与常数和的方差 |

D(X+c)=D(X) |

无 |

方差具有平移不变性。 |

| 常数倍的方差 |

D(aX)=a2D(X) |

无 |

系数要平方! D(aX+b)=a2D(X) |

| 和/差的方差 |

D(X±Y)=D(X)+D(Y)±2Cov(X,Y) |

无 |

这是普适公式,需要用到协方差。 |

| 独立和/差的方差 |

D(X±Y)=D(X)+D(Y) |

X,Y 相互独立 |

只有在独立时,才能直接相加! 此时 Cov(X,Y)=0。 |

| 线性组合的方差 |

D(aX+bY)=a2D(X)+b2D(Y)+2abCov(X,Y) |

无 |

这是更一般的情况。若 X,Y 独立,则此公式退化为 a2D(X)+b2D(Y)。 |

| 样本均值X的方差 |

D(X)=nσ2 |

样本 Xi 来自正态总体 N(μ,σ2),相互独立 |

|

| 样本方差S2的方差 |

D(S2)=n−12σ4 |

样本 Xi 来自正态总体 N(μ,σ2),相互独立,且此时 S2 和 X 必定相互独立 |

|

| 正态样本的绝对值∣X∣的期望 |

D(∣X∣)=(1−π2)σ2 |

Xi∼N(0,σ2) |

|

三、协方差 (Cov(X,Y)) 与相关系数 (ρXY)

1. 协方差

- 定义:Cov(X,Y)=E[(X−E(X))(Y−E(Y))]

- 计算公式:Cov(X,Y)=E(XY)−E(X)E(Y)

- 性质:

- Cov(X,Y)=Cov(Y,X)

- Cov(aX,bY)=ab⋅Cov(X,Y)

- Cov(X1+X2,Y)=Cov(X1,Y)+Cov(X2,Y)

- 若 X,Y 相互独立,则 Cov(X,Y)=0。反之不一定成立!

2. 相关系数

- 定义:ρXY=D(X)D(Y)Cov(X,Y)

- 性质:

- 有界性:∣ρXY∣≤1。

- ∣ρXY∣=1⟺ X,Y 完全线性相关。

- ρXY=0⟺ X,Y 不相关。

3. 重要推论与例题

-

例:二维正态分布下,和与差的相关性

问题:设随机变量 (X,Y) 服从二维正态分布,令 U=X+Y,V=X−Y。试求 U 与 V 不相关的充要条件。

解:

要使 U 与 V 不相关,其充要条件是 Cov(U,V)=0。我们来计算其协方差:

Cov(U,V)=Cov(X+Y,X−Y)=Cov(X,X−Y)+Cov(Y,X−Y)(利用协方差的可加性)=[Cov(X,X)−Cov(X,Y)]+[Cov(Y,X)−Cov(Y,Y)]=D(X)−Cov(X,Y)+Cov(Y,X)−D(Y)=D(X)−D(Y)(因为 Cov(X,Y)=Cov(Y,X))

令 Cov(U,V)=0,即可得 D(X)−D(Y)=0,即 D(X)=D(Y)。

结论:

U 与 V 不相关的充要条件是 X 与 Y 的方差相等,即 D(X)=D(Y) 或 σX2=σY2。

重要推广:

由于 (X,Y) 服从二维正态分布,其线性组合 (U,V) 也服从二维正态分布。对于二维正态分布来说,"不相关"与"相互独立"是等价的。因此,D(X)=D(Y) 也是 U 与 V 相互独立的充要条件。

第三部分:数理统计入门

一、切比雪夫不等式 (Chebyshev’s Inequality)

切比雪夫不等式是一个重要的概率不等式,它给出了随机变量偏离其期望的概率上界,优点在于对随机变量的分布无任何要求。通俗理解是:“随机变量离中心点应该相差不远”

-

定理:设随机变量 X 具有数学期望 E(X)=μ 和方差 D(X)=σ2<∞。则对于任意正数 ε,有:

P{∣X−μ∣≥ε}≤ε2σ2

或者等价地:

P{∣X−μ∣<ε}≥1−ε2σ2

-

核心思想:随机变量的取值越分散 (即方差 σ2 越大),其偏离期望 μ 的概率就越大。这个不等式是许多极限定理证明的基础。

二、大数定律与中心极限定理

大数定律与中心极限定理是概率论中描述随机变量序列极限行为的两个核心定理,是连接概率论与数理统计的桥梁。

1. 依概率收敛 (Convergence in Probability)

在讨论大数定律之前,我们首先需要理解“依概率收敛”的含义。它是描述随机变量序列极限行为的一种方式。

-

定义:设 Y1,Y2,…,Yn,… 是一个随机变量序列, a 是一个常数。如果对于任意给定的正数 ε,都有:

n→∞limP{∣Yn−a∣<ε}=1

或者等价地:

n→∞limP{∣Yn−a∣≥ε}=0

那么,我们称随机变量序列 {Yn} 依概率收敛于 a,记作 YnPa。

-

直观理解:当 n 足够大时,随机变量 Yn 的取值落在常数 a 的任意小的邻域内的概率会无限接近于1。也就是说,Yn 与 a 之间出现较大偏差的可能性会变得微乎其微。

2. 大数定律 (Law of Large Numbers, LLN)

大数定律从理论上解释了“频率稳定于概率”这一经验观察,是数理统计中一系列极限定理的总称。它们都表明,当样本容量 n 足够大时,样本均值会依概率收敛于总体期望。

- 切比雪夫大数定律 (Chebyshev’s LLN):XpE(X):

- 条件:设 X1,X2,…,Xn 是一列相互独立的随机变量序列,且方差存在并一致有上界 (即 D(Xi)≤C)。

- 结论:即样本均值 X=n1i=1∑nXi 依概率收敛于其期望的均值 E(X)=n1i=1∑nE(Xi)。

n1i=1∑nXipn1i=1∑nE(Xi)

- **说明**:适用范围较广的大数定律,不要求随机变量同分布。

3. 中心极限定理 (Central Limit Theorem, CLT)

中心极限定理是概率论的“皇冠”,它揭示了为何正态分布在自然界和统计学中如此普遍。它指出,在很宽松的条件下,大量相互独立的随机变量之和 (或均值),其分布会近似于正态分布。

三、数理统计的基本概念

设 X1,X2,…,Xn 是来自总体X的简单随机样本,E(X)=μ,D(X)=σ2。

- 样本均值:X=n1i=1∑nXi

- 样本方差:S2=n−11i=1∑n(Xi−X)2

样本均值的期望与方差

- 期望:E(X)=μ (样本均值的期望等于总体期望)

- 方差:D(X)=nσ2 (样本均值的方差是总体方差的 1/n)

样本方差的期望与方差

由于样本方差可视为服从卡方分布,因此可以利用卡方分布的期望与方差来求解样本方差的期望与方差。

σ2(n−1)S2⇒⇒=σ2i=1∑n(Xi−X)2∼χ2(n−1)⎩⎨⎧E[σ2(n−1)S2]=(n−1)D[σ2(n−1)S2]=2(n−1)⎩⎨⎧E(s2)=n−1σ2(n−1)=σ2D(s2)=[n−1σ2]22(n−1)=n−12σ4

- 期望:E[σ2(n−1)S2]=(n−1) (样本方差的期望等于总体方差)

- 方差:D[σ2(n−1)S2]=2(n−1)

二项分布的三种计算方法:

已知X∼B(n,p)

- n不太大(n≤10)时:用二项分布公式直接计算

P{X=k}=Cnkpk(1−p)n−k

- n较大且p较小,λ=np适中,由泊松分布近似:

P{X=k}=Cnkpk(1−p)n−k≈k!λke−λ

- n较大且p不太大(p<0.1,np≥10)由中心极限定理:

P{a<X<b}=Φ(np(1−p)b−np)−Φ(np(1−p)a−np)

四、三大抽样分布 (基于正态总体)

设 X1,…,Xn 来自正态总体 N(μ,σ2)。

-

卡方分布 (χ2):

- 定义:n 个相互独立的标准正态随机变量的平方和,服从自由度为 n 的卡方分布。i=1∑nXi2∼χ2(n) (其中Xi∼N(0,1))。

- 性质:

- 期望:E(χ2)=n

- 方差:D(χ2)=2n

- 重要结论:

σ2i=1∑n(Xi−μ)2σ2(n−1)S2=σ2i=1∑n(Xi−X)2∼χ2(n)∼χ2(n−1)

⇒⇒⎩⎨⎧E[σ2(n−1)S2]=(n−1)D[σ2(n−1)S2]=2(n−1)⎩⎨⎧E(s2)=n−1σ2(n−1)=σ2D(s2)=[n−1σ2]22(n−1)=n−12σ4

两个式子分别体现:

- 卡方分布的可加性;

- 样本方差代替总体方差,损失一个自由度。

-

t分布:

- 定义:设 X∼N(0,1), Y∼χ2(n),且X, Y独立,则

t=Y/nX∼t(n)

- 性质:

- 期望:E(t)=0 (当自由度 n>1 时)

- 方差:D(t)=n−2n (当自由度 n>2 时)

- 重要结论:当 σ2 未知时,用样本方差代替总体方差,损失一个自由度,得到

σ2(n−1)S2/(n−1)σ/nX−μ=S/nX−μ∼t(n−1)

-

F分布:

- 定义:设 X∼χ2(n1), Y∼χ2(n2),且X, Y独立,则 F=Y/n2X/n1∼F(n1,n2)。

- 性质:

- 期望:E(F)=n2−2n2 (当 n2>2 时)

- 方差:D(F)=n1(n2−2)2(n2−4)2n22(n1+n2−2) (当 n2>4 时)

-

重要结论:

- F(n1,n2)1=X/n1Y/n2∼F(n2,n1)=F(n2,n1)1

- F1−α(n1,n2)=Fα(n2,n1)1

- t=Y/nX∼t(n)时,t2=Y/nX2/1∼F(1,n)

- 由于样本均值X∼N(μ,nσ2),那么将样本均值标准化后,得到(σ/nX−μ)2∼χ2(1)

- 又由上已推导出σ2(n−1)S2=i=1∑n(σXi−X)2∼χ2(n−1),因此由F分布的定义,得到

(σ2(n−1)S2)/(n−1)(σ/nX−μ)2/1=S2n(X−μ)2∼F(1,n−1)

- 已知 X=σ12(n1−1)S12∼χ2(n1−1) 和 Y=σ22(n2−1)S22∼χ2(n2−1) 相互独立。根据F分布的构造,F=Y/(n2−1)X/(n1−1),将X和Y的表达式代入后,分子分母中的自由度

(n-1)恰好被约去,即得:

S22/σ22S12/σ12∼F(n1−1,n2−1)

第四部分:参数估计

参数估计是利用从总体中抽取的样本信息,来估计总体分布中的未知参数。

一、点估计 (Point Estimation)

点估计是构造一个适当的统计量 θ^(X1,…,Xn),用其观测值作为未知参数 θ 的估计值。

1. 矩估计法 (Method of Moments, MM)

矩估计法的思想:用样本的矩去估计总体的矩。

-

核心思想:令样本矩等于相应的总体矩,构成关于待估参数的方程(组),解此方程(组)即可得到参数的估计量。

-

步骤:

- 计算总体矩:设待估参数为 θ1,…,θk。计算总体的前 k 阶原点矩 E(X),E(X2),…,E(Xk),它们通常是参数的函数。

- 计算样本矩:计算相应的样本前 k 阶原点矩 Aj=n1i=1∑nXij。

- 建立方程组:令 E(Xj)=Aj, j=1,…,k。

- 求解:解这个关于 θ1,…,θk 的方程组,得到的解即为矩估计量 θ^1,…,θ^k。

-

例:设总体 X 的期望 E(X)=μ, 方差 D(X)=σ2 均未知。

- E(X)=μ

- E(X2)=D(X)+[E(X)]2=σ2+μ2

- 令 E(X)=X 和 E(X2)=A2=n1∑Xi2

- 得到方程组:

{μ=Xσ2+μ2=n1∑Xi2

- 解得矩估计量:

{μ^=Xσ^2=n1∑Xi2−(X)2=n1∑(Xi−X)2

2. 极大似然估计法 (Maximum Likelihood Estimation, MLE)

极大似然估计是应用最广泛的点估计方法,其统计性质通常优于矩估计。

-

核心思想:“已发生的事,就认为它发生的概率最大”。即寻找参数 θ 的估计值 θ^,使得在给定样本观测值 (x1,…,xn) 的条件下,该样本出现的概率 (似然函数) 达到最大。

-

步骤:

- 写出似然函数 L(θ):

- 离散型:L(θ)=P{X1=x1,…,Xn=xn}=∏i=1nP{X=xi;θ}

- 连续型:L(θ)=∏i=1nf(xi;θ) (这里是联合密度函数在样本点的值)

- 取对数:lnL(θ)=∑i=1nlnf(xi;θ)。取对数是为了将连乘变为连加,方便求导。

- 求解最大值:寻找使对数似然函数 lnL(θ) 达到最大的参数值 θ^。这通常需要分情况讨论:

- 情况一:函数有驻点。如果 L(θ) 在参数空间内部的可导点取得最大值,则该点必为驻点。

- 取对数:为计算方便,通常先取对数,得到对数似然函数 lnL(θ)=∑i=1nlnf(xi;θ)。

- 求导解方程:对 lnL(θ) 关于每个参数求偏导,并令其为 0,解似然方程(组)。

∂θj∂lnL(θ)=0,j=1,…,k

- 求解:若方程的解在参数空间内,则该解即为极大似然估计量 θ^。

- 情况二:函数无驻点(单调)。如果似然函数在参数空间内是单调的,其最大值必在参数空间的边界处取得。

- 分析单调性:直接分析 L(θ) 的单调性(此时取对数不是必须的,根据函数形式决定是否方便)。

- 确定边界值:根据参数的定义域和函数的单调性,确定使似然函数最大化的边界值,该值即为极大似然估计量 θ^。

- 求解:方程(组)的解即为极大似然估计量 θ^。

-

例:设总体 X∼E(λ),即指数分布,f(x;λ)=λe−λx (x>0)。

- 似然函数:L(λ)=∏i=1nλe−λxi=λne−λ∑xi

- 对数似然:lnL(λ)=nlnλ−λ∑xi

- 求导:dλdlnL(λ)=λn−∑xi=0

- 解得:λ^=∑xin=X1。

二、估计量的评价标准

1. 无偏性 (Unbiasedness)

- 定义:若估计量 θ^ 的数学期望等于参数 θ 的真值,即 E(θ^)=θ,则称 θ^ 是 θ 的无偏估计量。

- 直观理解:无偏性意味着估计量没有系统性的偏差。多次重复抽样得到的估计值的平均数,会等于参数的真值。

- 重要结论:

- 样本均值 X:是总体期望 μ 的无偏估计,因为 E(X)=μ。

- 样本方差 S2:S2=n−11i=1∑n(Xi−X)2 是总体方差 σ2 的无偏估计,因为 E(S2)=σ2。

- 注意:矩估计得到的 σ^2=n1i=1∑n(Xi−X)2 不是 σ2 的无偏估计,它是有偏的,因为 E(σ^2)=nn−1σ2。

2. 有效性 (Efficiency)

- 定义:有效性是衡量估计量优劣的第二个标准,它关注的是估计量的方差。对于两个不同的无偏估计量 θ^1 和 θ^2,如果 D(θ^1)<D(θ^2),则称 θ^1 比 θ^2 更有效。

- 直观理解:在无偏的前提下,方差越小,估计值的波动就越小,估计结果就越稳定、越集中在真值附近。

3. 一致性 (Consistency)

- 定义:设 θ^n 是基于样本容量 n 的估计量。如果当 n→∞ 时,θ^n 依概率收敛于参数真值 θ,即 θ^nPθ,则称 θ^n 是 θ 的一致估计量 (或相合估计量)。

- 直观理解:一致性是一个“大样本”性质。它表明,只要样本容量足够大,我们得到的估计值就会以极大的概率接近于参数的真值。

- 判定定理 (充分条件):如果估计量 θ^n 满足:

- E(θ^n)→θ (当 n→∞) (渐进无偏)

- D(θ^n)→0 (当 n→∞)

则 θ^n 是 θ 的一致估计量。

三、区间估计 (Interval Estimation)

点估计只给出一个估计值,但无法衡量其精度。区间估计则给出一个区间,并给出该区间包含参数真值的可信程度。

构造置信区间的方法:枢轴量法

- 寻找枢轴量:构造一个样本的函数 G(X1,…,Xn;θ),它同时依赖于样本和待估参数 θ,但其概率分布不依赖于任何未知参数。

- 确定分位点:根据置信水平 1−α,找到枢轴量分布的两个分位点 a,b,使得 P{a<G<b}=1−α。

- 反解不等式:从不等式 a<G(X1,…,Xn;θ)<b 中解出 θ,即可得到 θ 的置信区间。

常见正态总体参数的置信区间汇总

| 待估参数 |

已知条件 |

枢轴量及其分布 |

置信区间 (1−α) |

| 均值 μ |

σ2 已知 |

Z=σ/nX−μ∼N(0,1) |

(X∓zα/2nσ) |

|

σ2 未知 |

t=S/nX−μ∼t(n−1) |

(X∓tα/2(n−1)nS) |

| 方差 σ2 |

μ 未知 |

χ2=σ2(n−1)S2∼χ2(n−1) |

(χα/22(n−1)(n−1)S2,χ1−α/22(n−1)(n−1)S2) |

均值差

μ1−μ2 |

σ12,σ22 已知 |

Z=σ12/n1+σ22/n2(X1−X2)−(μ1−μ2)∼N(0,1) |

(X1−X2)∓zα/2n1σ12+n2σ22 |

方差比

σ12/σ22 |

均值未知 |

F=S22/σ22S12/σ12∼F(n1−1,n2−1) |

(S22S12Fα/2(n1−1,n2−1)1,S22S12F1−α/2(n1−1,n2−1)1) |